Mit dem EU AI Act – offiziell „Verordnung (EU) 2024/1689 über Künstliche Intelligenz“ [1] – hat die Europäische Union im Jahr 2024 den weltweit ersten umfassenden Rechtsrahmen für Künstliche Intelligenz geschaffen. In Deutschland spricht man häufig von der „KI-Verordnung“. Sie ist seit August 2024 in Kraft und wird schrittweise angewendet (vgl. KI-Verordnung tritt in Kraft – Europäische Kommission). Dieser folgende Artikel dient ausschließlich der Orientierung.

Zielsetzung des EU AI Act

Der EU AI Act verfolgt das Ziel, einen einheitlichen Rechtsrahmen für den Einsatz von KI-Systemen innerhalb der Europäischen Union zu schaffen. Er soll sicherstellen, dass KI-Anwendungen mit den europäischen Grundrechten, Sicherheitsanforderungen und bestehenden Rechtsnormen vereinbar sind. Gleichzeitig dient er der Harmonisierung nationaler Regelungen und der Schaffung klarer rechtlicher Rahmenbedingungen für Anbieter und Betreiber von KI-Systemen.

Begriffsdefinitionen und Verständnis von KI

Der AI Act definiert, was im regulatorischen Kontext als KI-System gilt. Maßgeblich ist dabei nicht eine einzelne Technologie, sondern ein funktionaler Ansatz: Ein KI-System ist ein maschinengestütztes System, das für einen bestimmten Zweck Ergebnisse wie Vorhersagen, Empfehlungen oder Entscheidungen erzeugt und dabei ein gewisses Maß an Autonomie aufweist. Die Verordnung orientiert sich damit an einem breiten, technologieoffenen KI-Begriff.

Geltungsbereich

Der Geltungsbereich des EU AI Act umfasst:

- Anbieter von KI-Systemen, die diese innerhalb der EU in Verkehr bringen oder in Betrieb nehmen

- Betreiber von KI-Systemen mit Sitz oder Niederlassung in der EU

- Anbieter und Betreiber außerhalb der EU, sofern die Ergebnisse der KI-Systeme in der EU genutzt werden

Der AI Act gilt nicht nur für Organisationen mit Sitz in der EU, sondern – analog zur DSGVO – auch für Anbieter und Betreiber außerhalb der EU, sofern die Ergebnisse ihrer KI-Systeme innerhalb der Europäischen Union genutzt werden. Damit folgt der AI Act einem extraterritorialen Ansatz, vergleichbar mit der DSGVO.

Risikobasierte Systematik

Kern der Regulierung ist ein risikobasierter Ansatz. Der EU AI Act unterscheidet vier Risikokategorien, die in der folgenden Tabelle dargestellt sind:

| Risikokategorie | Beschreibung | Regulatorischer Status |

|---|---|---|

| Unzulässige KI-Systeme | KI-Anwendungen, die mit Grundrechten unvereinbar sind | Verboten |

| Hochrisiko-KI | KI-Systeme in sensiblen oder sicherheitsrelevanten Einsatzbereichen | Strenge Anforderungen |

| KI mit Transparenzpflichten | Systeme mit direkter Interaktion mit Menschen | Transparenzvorgaben |

| Geringes oder minimales Risiko | KI-Systeme ohne signifikantes Risiko | Keine zusätzlichen Pflichten |

Diese Einteilung bildet die Grundlage für die im EU AI Act vorgesehenen abgestuften Anforderungen an KI-Systeme.

Zentrale Pflichten und Anforderungen

Für regulierte KI-Systeme beschreibt der AI Act unter anderem:

- Anforderungen an Datenqualität und Datenmanagement

- Vorgaben zur technischen Dokumentation

- Pflichten zur menschlichen Aufsicht

- Regelungen zur Transparenz und Nachvollziehbarkeit

- Mechanismen zur Marktüberwachung und Durchsetzung

Die konkrete Ausgestaltung dieser Pflichten hängt von der jeweiligen Risikokategorie ab

Verhältnis zu bestehendem EU-Recht

Der EU AI Act ergänzt bestehende europäische Regelwerke, insbesondere die DSGVO. Er ersetzt diese nicht, sondern fügt eine eigenständige, KI-spezifische Regulierungsebene hinzu.

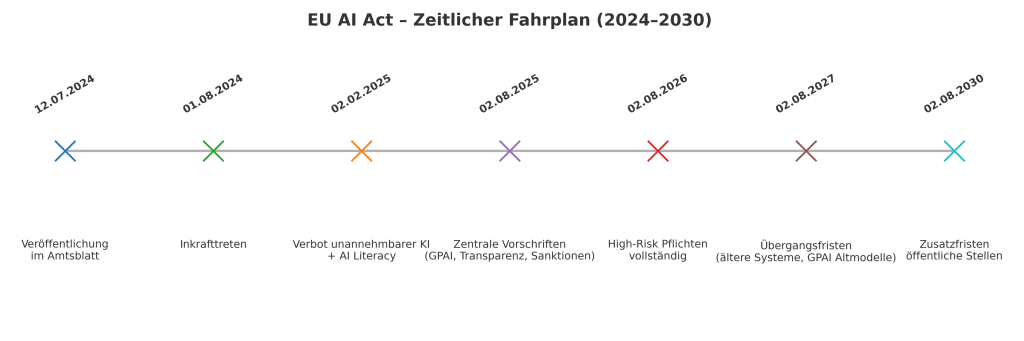

Zeitlicher Fahrplan

Der AI Act ist als Verordnung unmittelbar in allen Mitgliedstaaten anwendbar. Nach Inkrafttreten gelten Übergangsfristen, bevor die einzelnen Pflichten verbindlich greifen. Die vollständige Anwendung erfolgt schrittweise über mehrere Jahre.

| Datum | Was wird wirksam / was muss ab dann gelten | Für wen / was gilt es besonders |

|---|---|---|

| 12.07.2024 | Veröffentlichung des Gesetzestextes im Amtsblatt der EU | Gesetz existiert ab dann offiziell. |

| 01.08.2024 | Inkrafttreten des AI Act (Verordnung gilt rechtlich) | Alle EU-Mitgliedstaaten müssen das Gesetz als verbindliche Regelung übernehmen. |

| 02.02.2025 | Erste Pflichten: Verbot von KI-Systemen mit unannehmbarem Risiko; Pflicht zur KI-Kompetenz („AI literacy“) für Personen, die mit KI-Systemen arbeiten. | Anbieter und Nutzer, auch Entwicklungsverantwortliche; alle, die solche riskanten KI-Systeme einsetzen oder entwickeln. |

| 02.08.2025 | Viele zentrale Vorschriften werden verbindlich: z. B. Regeln für General-Purpose AI (GPAI), Governance, Transparenzpflichten, Sanktionen, Konformitätsbewertungsstellen (notifizierte Stellen). | Anbieter, Verteiler und Betreiber von KI-Systemen, besonders GPAI-Modelle und Hochrisiko-KI. |

| 02.08.2026 | Vollere Anwendung der Anforderungen für Hochrisiko-KI: z. B. Risikomanagement, Datenqualität, Transparenz, menschliche Aufsicht, technische Dokumentation. Viele der High-Risk-Pflichten werden dann vollständig wirksam. | Vor allem Anbieter/Besitzer von Hochrisiko-KI-Systemen, aber auch Nutzer, bei denen die Systeme eingesetzt werden. |

| 02.08.2027 | Übergangsfristen für gewisse besondere Fälle laufen aus: z. B. für Hochrisiko-KI, die als Produktbestandteil vor dem Stichtag in Verkehr gebracht wurden; vollständige Konformität von GPAI-Modellen, die vor dem 2. August 2025 in Betrieb genommen wurden. Ebenso gelten bestimmte spezifische Vorschriften (Artikel 6 Abs. 1, bestimmte Sicherheits-/Produktvorschriften) ab dann. | Anbieter dieser älteren Systeme / Geräte; Systeme, die vor den Stichtagen eingeführt wurden; Hersteller von Komponenten und High-Risk Systemen mit eingebetteter KI. |

| 02.08.2030 | Für öffentliche Stellen (Behörden etc.) zusätzliche Fristen und Übergangsregelungen gelten, z. B. in manchen Mitgliedstaaten bei Hochrisiko-Systemen; konforme Anpassung spätestens bis zu diesem Datum in manchen Fällen erforderlich. |

Kontext & weiterführende Details:

- Es gibt Übergangsfristen: Systeme, die vor bestimmten Stichtagen eingeführt oder in Betrieb genommen wurden, haben längere Zeiträume, um konform zu werden. Beispielsweise GPAI-Modelle, die vor dem 2. August 2025 in Betrieb waren, müssen bis zum 2. August 2027 vollständig konform sein.

- Nicht alle Bestimmungen gelten sofort; manche Kapitel und Artikel treten gestaffelt in Kraft, je nach Risiko und Rolle (Anbieter, Nutzer, Modifizierer etc.).

- Forschungs- und Entwicklungsaktivitäten sind nicht in vollem Umfang erfasst bis zur Markteinführung / Inbetriebnahme eines KI-Systems, aber bestimmte Tests unter Realbedingungen können bereits unter die Verordnung fallen.

Zusammenfassung

Der EU AI Act schafft einen einheitlichen, risikobasierten Rechtsrahmen für Künstliche Intelligenz in der Europäischen Union. Er definiert, was als KI-System gilt, legt seinen räumlichen und sachlichen Geltungsbereich fest und ordnet KI-Anwendungen in Risikokategorien ein. Auf dieser Basis beschreibt die Verordnung abgestufte Anforderungen und Pflichten für Anbieter und Betreiber. Ziel ist rechtliche Klarheit und eine konsistente Regulierung von KI-Systemen innerhalb des europäischen Binnenmarkts.